随着互联网信息的爆炸式增长,如何高效、准确地从海量数据中提取有价值的信息成为了一个重要的技术挑战。爬虫技术,作为解决这一问题的关键工具,受到了广泛的关注和应用。本文将对爬虫技术进行深入解析,并通过实战代码示例展示其高级应用。

一、爬虫技术概述

爬虫技术,也称为网络爬虫或网页蜘蛛,是一种自动从互联网上抓取信息的程序。它通过模拟人类浏览器的行为,自动访问网页并提取其中的数据。爬虫技术的应用场景非常广泛,包括搜索引擎、数据分析、市场研究、舆情监控等。

二、爬虫技术原理

爬虫技术的基本原理包括目标网页分析、URL管理、网页下载、数据解析和存储等步骤。其中,目标网页分析是确定要爬取哪些网页和如何爬取的过程;URL管理用于记录已爬取和待爬取的网页链接,避免重复爬取;网页下载是通过HTTP请求获取网页内容;数据解析则是从网页中提取所需数据的过程;最后,将解析得到的数据存储到数据库或文件中。

三、爬虫技术高级应用

- 异步爬虫

为了提高爬虫的效率和响应速度,可以采用异步爬虫技术。异步爬虫可以同时处理多个HTTP请求,而无需等待上一个请求完成。Python中的asyncio库是实现异步爬虫的强大工具。以下是一个简单的异步爬虫示例:

python

import asyncio

import aiohttp

from aiohttp import ClientSession async def fetch(session, url): async with session.get(url) as response: return await response.text() async def main(): async with ClientSession() as session: html1 = await fetch(session, 'http://example.com/page1') html2 = await fetch(session, 'http://example.com/page2') # 后续的数据处理... # 运行事件循环

loop = asyncio.get_event_loop()

loop.run_until_complete(main())在上面的示例中,我们使用了aiohttp库来发送异步HTTP请求,并通过asyncio的事件循环来管理这些请求。

- 代理与反反爬虫

在爬虫过程中,经常会遇到目标网站的反爬虫策略,如IP封锁、验证码等。为了绕过这些策略,我们可以使用代理IP和模拟人类行为等技术。例如,使用requests库结合proxies参数可以设置代理IP;通过添加随机延时、模拟用户操作等方式来模拟人类行为。

- 数据清洗与存储

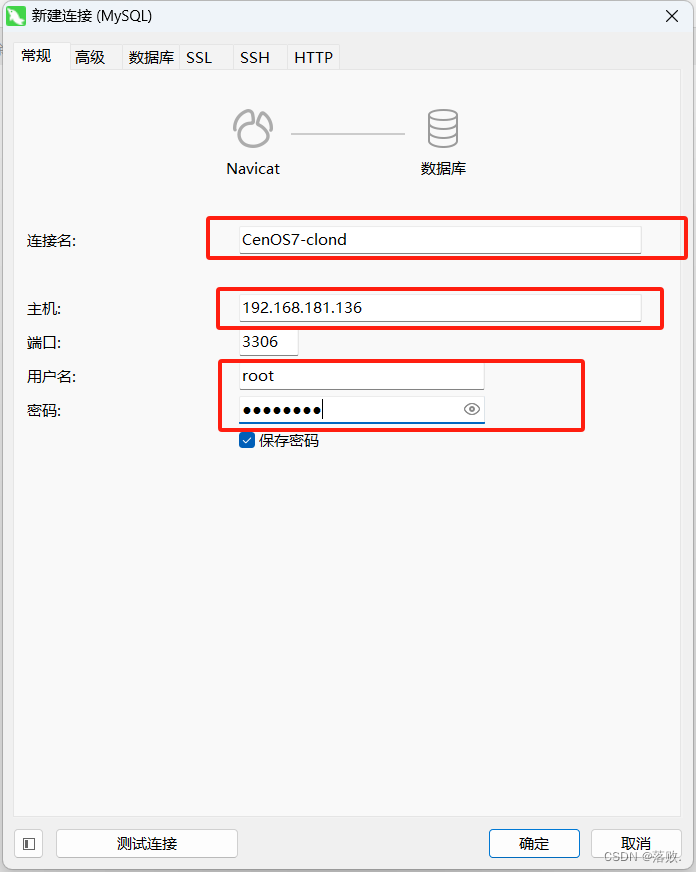

爬虫获取的数据往往包含大量无用信息或格式不统一,需要进行数据清洗和转换。Python中的pandas库是处理这类问题的强大工具。清洗后的数据可以存储到数据库(如MySQL、MongoDB)或文件(如CSV、JSON)中,以便后续分析和使用。

四、总结

爬虫技术是一项强大的工具,可以帮助我们高效地从互联网上提取有价值的信息。然而,在使用爬虫技术时,我们也需要注意遵守法律法规和网站的使用协议,避免对目标网站造成不必要的负担和损害。通过不断学习和实践,我们可以掌握更多高级的爬虫技术,并将其应用到实际场景中,为企业和个人创造更多的价值。